Nel suo romanzo Il sole nudo (1957), lo scrittore di fantascienza Isaac Asimov immaginò un pianeta, Solaria, abitato nel 47° secolo da un numero molto ristretto di esseri umani assistiti da migliaia di robot e interagenti tra loro tramite avatar. … Quando si incontrano per chiacchierare, passeggiare o anche mangiare, i solariani non vanno di persona. Lo fanno senza uscire di casa, inviando le loro copie tecnologiche, in questo caso ologrammi, all’incontro. Immagina di poter visitare la Biennale di Venezia senza lasciare la tua città, e invia invece un bot attraverso il quale puoi vedere cosa è esposto lì. Oppure puoi anche abbracciare la guida. Non è fantascienza, è realtà pratica con il robot iCub, sviluppato dai ricercatori dell’Istituto Italiano di Tecnologia (IIT).

“Sentirsi e muoversi da qualche parte senza esserci, questo è l’obiettivo principale del nuovo sistema avanzato di telepresenza per il robot iCub, chiamato anche sistema avatar iCub3”, affermano l’IIT di Genova. L’iCub è un robot umanoide simile a un bambino, leggermente più grande delle sue versioni precedenti, che pesavano 33 chilogrammi ed erano alti poco più di un metro. L’iCub3 pesa 52 kg ed è lungo 1,25 m. Creato dal centro tecnologico italiano e da un consorzio di diverse università europee, può camminare, sedersi e persino muoversi a quattro zampe. In quanto robot sociale, il suo volto è progettato per poter riprodurre le espressioni facciali umane.

Lo sviluppo ora presentato è il risultato di una ricerca condotta da un team coordinato da Daniele Bucci, ricercatore principale del Laboratorio di Intelligenza Artificiale e Meccanica (AMI). Il loro obiettivo è avere robot umanoidi che possano agire come avatar, ovvero corpi robotici che agiscono al posto degli umani senza sostituirli ma permettendo loro di esistere dove non possono. Ad esempio, visitare una mostra, anche se vengono suggerite molte altre applicazioni.

Molteplici applicazioni

“Crediamo che questa direzione di ricerca abbia un enorme potenziale in molti settori”, spiega Bucci. “Da un lato, l’attuale pandemia ci ha insegnato che sistemi avanzati di telepresenza possono diventare molto rapidamente necessari in diversi ambiti, come quello sanitario e logistico. D’altro canto, gli avatar potrebbero consentire alle persone con gravi disabilità fisiche di lavorare ed eseguire compiti nel mondo reale attraverso un corpo robotico. “Questo potrebbe rappresentare un progresso nelle tecniche di riabilitazione e nelle protesi”.

Le capacità dell’iCub3 sono state dimostrate durante un giro turistico. Un lavoratore umano che si trovava a Genova, presso la sede dell’Istituto Internazionale di Tecnologia, ha “visitato” il padiglione italiano alla 17. Mostra Internazionale di Architettura – Biennale di Venezia, a 300 chilometri di distanza. In effetti, la persona che entrava nella mostra era questa nuova versione di un robot umanoide. Il primo ha fatto passare il secondo attraverso la connessione in fibra ottica sottostante, con un ritardo di soli pochi millisecondi. “I ricercatori hanno dimostrato che il sistema trasmette il movimento, la manipolazione, la voce e le espressioni facciali dell’operatore all’avatar robotico, ricevendo feedback visivo, uditivo e tattile”, secondo l’IIT. Cioè, il “turista” immobile vede attraverso gli occhi del robot, cammina con le sue gambe e gioca con le sue mani, le cui cinque dita producono le stesse articolazioni delle articolazioni umane. Ha anche sentito e parlato attraverso il suo avatar.

Il robot attraversa il Padiglione Italia alla Biennale di Venezia.

IIT-Istituto Italiano di Tecnologia

Nella dimostrazione, il sistema iFeel dell’IIT ha tracciato i movimenti del corpo dell’operatore, che sono stati trasmessi all’iCub3 del fucile. Il robot si muoveva come il suo utente a Genova, comprese le espressioni facciali, fino al “battito delle palpebre e ai movimenti degli occhi”, che l’avatar “riproduceva con un alto livello di precisione”. L’utente ha potuto sorridere, parlare e stringere la mano alla guida a Venezia. E quando ha abbracciato il robot, l’operaio robot lo ha sentito grazie alla tuta IIT iFeel. La guida e l’utente possono parlare anche tramite Android.

“È la prima volta che un sistema con tutte queste caratteristiche viene testato utilizzando un robot umanoide dotato di gambe per il turismo remoto, in modo che l’operatore umano possa sentire e sperimentare ciò che sta accadendo nel luogo in cui si trova l’avatar”. Questo sistema è un prototipo e può essere ulteriormente sviluppato “per essere applicato in diverse situazioni, dalla risposta ai disastri all’assistenza sanitaria, e anche in futuro”, secondo Bucci.

“Appassionato di musica. Amante dei social media. Specialista del web. Analista. Organizzatore. Pioniere dei viaggi.”

More Stories

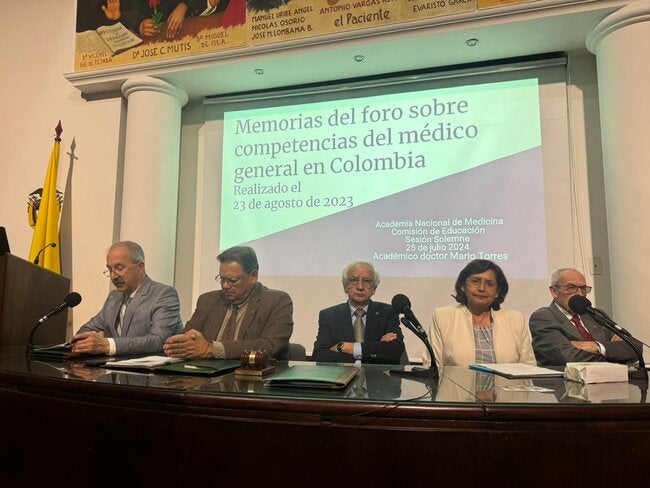

Rapporto dell’Accademia Nazionale di Medicina e dell’Organizzazione Panamericana della Sanità sul Forum delle competenze dei medici generali in Colombia – OPS/OMS

Congresso Internazionale di Patologia e Medicina Orale 2024 » Notizie UNSAM

Parla il capo dell’Associazione residenti